注目研究の紹介 2021年6月

本学の注目研究を毎月1つずつ紹介します。

※最新の注目研究や他のバックナンバーはこちら

顔画像からの人物の表情認識と表情強度推定

人の顔画像からの表情認識は、多様な分野に応用することができるため、広く研究が行われています。表情認識に関する研究においては、典型的な表情とされる、基本6表情(怒り、嫌悪、恐怖、幸福、悲しみ、驚き)が認識対象とされることが多いですが、例えば、同じ「幸福」を表す表情でも、微笑みと満面の笑顔とでは、その表情を表出している人が抱いている感情は異なっていると考えられます。

そこで、私達の研究グループでは、より詳細に人物の感情を捉えるため、表情の種類だけでなく、表情がどの程度強く表出しているかを表す「表情強度」を顔画像から推定する研究を行っています。

表情認識・表情強度推定に有用な特徴量

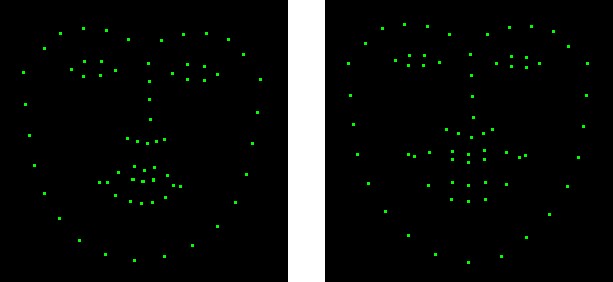

表情認識や表情強度推定を行う際には、表情表出時の顔の特徴的な変化を表現することのできる特徴量を用います。特徴量としては、例えば、顔画像を構成する各画素の明るさや、目や口などの顔の構成要素の形状など、様々なものが考えられますが、私達の研究グループでは、主に顔特徴点の位置関係を特徴量として用いています。この特徴量は、画像の明るさの違いに影響されにくく、顔特徴点の座標から単純な計算で求めることができるといった利点があります。また、人の目で見て、直感的に理解しやすいという特長もあります。図1は、無表情の顔画像と「幸福」の表情の顔画像から得られた顔特徴点を示しています。ここで、顔特徴点は、主として、眉・目・鼻・口の周辺と、顔の輪郭上の点を指します。顔特徴点だけを見ても、「幸福」の表情では、目が細められていたり、口角が上がっていたりすることから、表情の違いが分かるのではないでしょうか。

図1:無表情の顔画像から得られた顔特徴点(左)と「幸福」の顔画像から得られた顔特徴点(右)

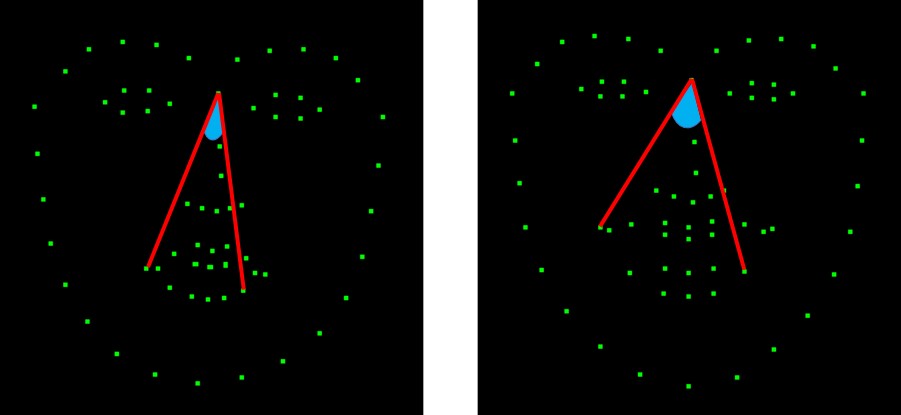

多くの人の顔画像から得られた顔特徴点を用いて、機械学習を行うことにより、どのような特徴量が表情の識別に有用であるかを判定したところ、例えば、図2に示すような、眉間の点と口の輪郭上の点を結ぶ2本の線分のなす角度(図中に水色で示している角度)が、「無表情」と「幸福」の表情の識別に有用であるという結果が得られました。ここに挙げたものの他にも、眉と目や、眉と口を結ぶ線分のなす角度なども、表情の識別に有用であることが判りました。

図2:「無表情」と「幸福」の識別に有効と判断された特徴量の一例

アンサンブル学習による表情認識と表情強度の推定

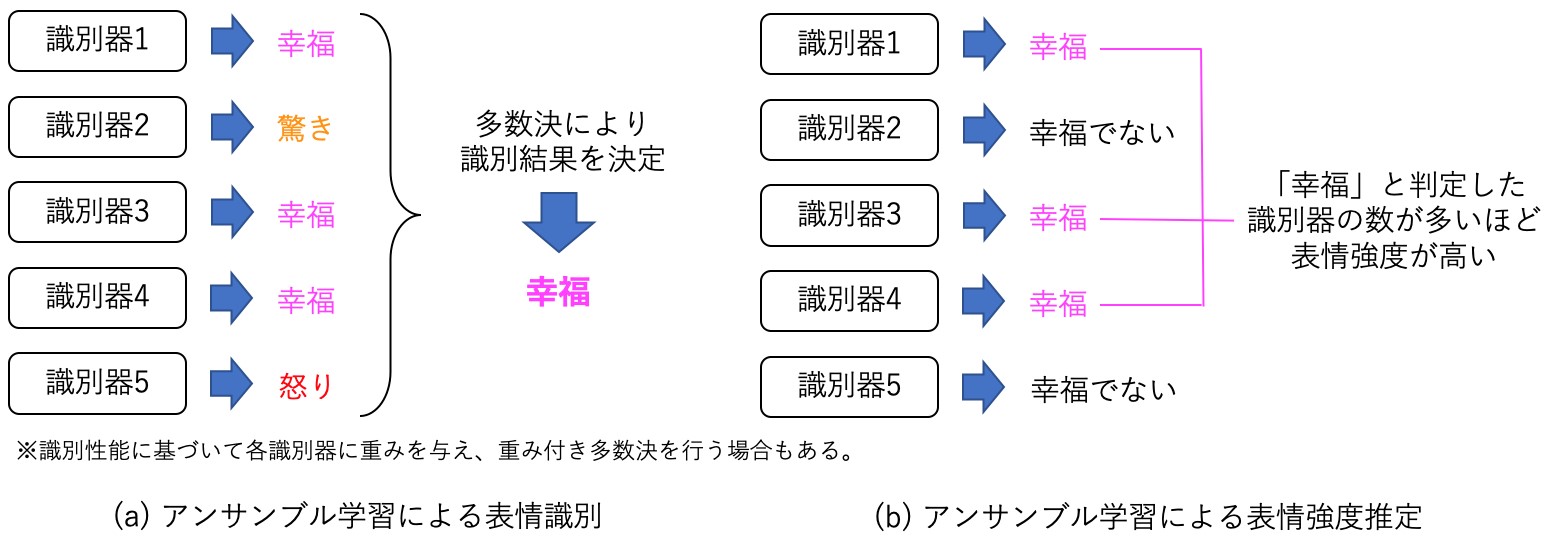

前述した特徴量を用いて、例えば、「角度が30度以上であれば「幸福」の表情である」といったようなルールを設けて、表情の認識を行うことができます。しかし、表情が表出する際の顔の変化は複雑であり、単一の特徴量だけを用いて表情を正確に識別することは非常に困難です。そこで、複数の特徴量を用いて、それぞれの特徴量に対して識別ルールを学習し、それらを組み合わせて最終的な識別結果を決定することにより、認識精度の向上を図っています。このような学習法は「アンサンブル学習」と呼ばれ、比較的単純な特徴量から精度の高い識別を行う手法として用いられています。

図3(a)は、アンサンブル学習による表情識別の例を示しています。「識別器」とは、いくつかの特徴量を用いて、画像中の人物の表情を識別する学習モデルを指しており、機械学習を行うことにより生成することができます。学習モデルには様々なものがあり、例えば、前述したような識別ルールをいくつか組み合わせて、表情を識別するものなどが挙げられます。識別器に顔特徴点を入力すると、その顔が表出している表情の種類が出力として得られます。アンサンブル学習においては、複数の識別器それぞれの出力による多数決を採ることで、最終的な識別結果を決定する手法がよく用いられます。例えば、図3(a)に示すように、5つの識別器のうち3つが「幸福」、1つが「驚き」、1つが「怒り」という識別結果を出力した場合、多数決により、最終的な識別結果は「幸福」となります。

また、同様の考え方を用いて、表情の強度を推定することもできます。図3(b)は、アンサンブル学習を用いた表情強度推定の例を示しています。この例では、「幸福」の表情強度を推定しており、全ての識別器の中で、「幸福」という識別結果を出力したものの数が多いほど、「幸福」の表情強度が高いとみなすことができます。

図3:アンサンブル学習による表情識別・表情強度推定

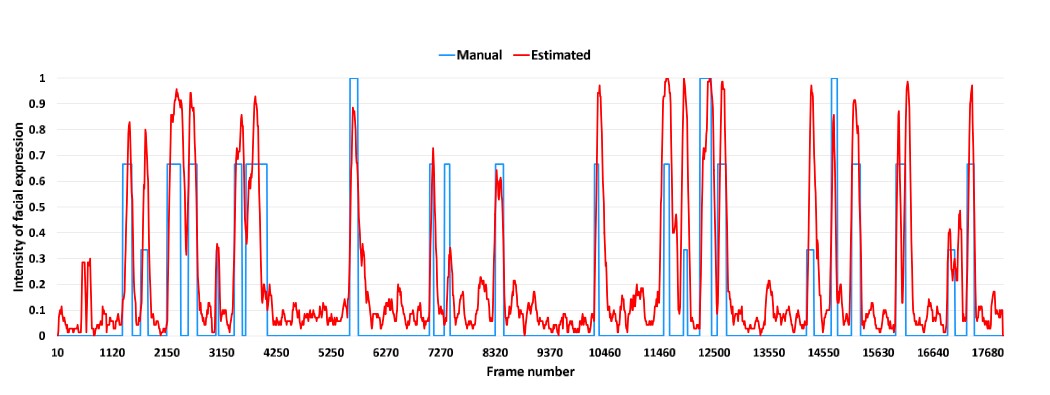

図4は、表情強度を推定した結果の一例を示しています。ここでは、カードゲームをしている人物の表情から、「幸福」に相当する笑顔の表情強度を推定しています。図中のグラフの横軸は、映像のフレーム数(経過時間に相当)を示しており、縦軸が笑顔の強度を示しています。また、青い線は、人間が映像を見て判断した笑顔の強度を示しており、赤い線は、アンサンブル学習により推定された笑顔の強度を示しています。ここでは、10個の識別器を用いたアンサンブル学習を行っています。人間による判断とは多少ずれがあるものの、笑顔が強く表出している箇所はおおむね推定できていることが確認できます。

図4:笑顔の強度推定結果の一例(青色の線は人が見て判断した強度、

赤色の線はアンサンブル学習モデルが推定した強度)

ここまでは、比較的単純な特徴量を用いた表情認識と表情強度推定について述べてきましたが、人の表出する表情は多種多様かつ非常に複雑であり、様々な表情を正確に識別するために、どのような特徴量を用いるのが適切であるかを判断することは非常に難しい問題であるといえます。そこで、近年では、深層学習を用いて、表情認識や表情強度の推定に有効な特徴量を学習によって生成する試みも始めています。

表情認識・表情強度推定の応用

表情認識や表情強度推定の応用として、映像中の人物の表情を手がかりとした映像検索手法の開発を行っています。図5は映像検索結果の一例を示しています。図の下部にはヒートマップが表示されており、映像中の人物の「幸福」の表情の表出を示しています。ヒートマップの横軸は時間を示しており、表情の強度はヒートマップの色の濃さで表されます。図ではスペースの都合上、1名分のヒートマップしか表示されていませんが、実際には全ての人物の基本6表情のヒートマップを確認できるようになっています。これにより、映像中の人物が特定の表情を表出しているシーンを容易に検索・提示することができます。例えば、映像中の人物が一斉に笑った(「幸福」の表情を表出した)シーンの検索などが可能です。

図5:映像中の人物の表情を手がかりとした映像検索システム

また、表情認識や表情強度推定の手法を用いて、画像や映像などのマルチメディアコンテンツ(以下、単に「コンテンツ」と表記)の評価を行う研究にも取り組んでいます。従来、このようなコンテンツは、アンケートなどによって人手で評価されていますが、近年では、個人でもコンテンツを作成・公開することが容易になっているため、インターネット上などには膨大な数のコンテンツが存在しています。それらを全て人手で評価することは非常に困難ですので、コンテンツを視聴している人物に対して、表情の認識や表情強度の推定を行い、コンテンツに対してどのような感情を抱いているのかを推定することにより、人手を介さない評価法の確立を目指しています。適切な評価を得るためには、微妙な表情の変化を的確に捉える必要が生じるため、今後も表情認識や表情強度の推定精度向上に取り組んでいきます。

【主な発表論文】

- H. Nomiya, S. Sakaue, T. Hochin, “Recognition and Intensity Estimation of Facial Expression Using Ensemble Classifiers,” Proc. of 15th IEEE/ACIS Intl. Conf. on Computer and Information Science, pp. 825-830, 2016.

- S. Sakaue, H. Nomiya, T. Hochin, “Estimation of Emotional Scene from Lifelog Videos in Consideration of Intensity of Various Facial Expressions,” Studies in Computational Intelligence, Vol. 721, pp. 121-136, 2017.

- Y. Sun, H. Nomiya, T. Hochin, “Automatic Evaluation of Motion Picture Contents by Estimation of Facial Expression Intensity,” Proc. of 20th IEEE/ACIS Intl. Conf. on Software Engineering, Artificial Intelligence, Networking and Parallel/Distributed Computing, pp. 227-232, 2019.

- N. Imamura, H. Nomiya, T. Hochin, “Finding Useful Features for Facial Expression Recognition and Intensity Estimation by Neural Network,” Intl. Journal of Software Innovation, pp. 68-84, 2020.

※最新の注目研究や他のバックナンバーはこちら